Nvidia a récemment ajouté une version non encore annoncée de son GPU de calcul A100 avec 80 Go de mémoire HBM2E dans un facteur de forme de carte standard pleine longueur et pleine hauteur (FLFH), ce qui signifie que ce GPU bestial tombe dans un emplacement PCIe tout comme un ‘ GPU ordinaire. Étant donné que les GPU de calcul de Nvidia comme A100 et V100 sont principalement destinés aux serveurs dans les centres de données cloud, Nvidia donne la priorité aux versions SXM (qui se montent sur une carte mère) par rapport aux versions PCIe classiques. Cela ne signifie pas pour autant que la société ne dispose pas de GPU de pointe dans un facteur de forme de carte PCIe standard.

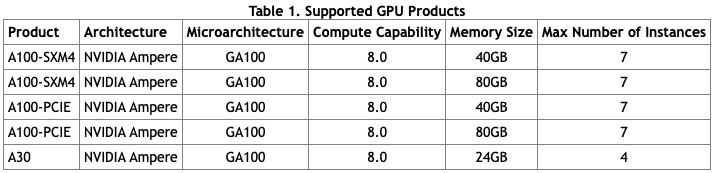

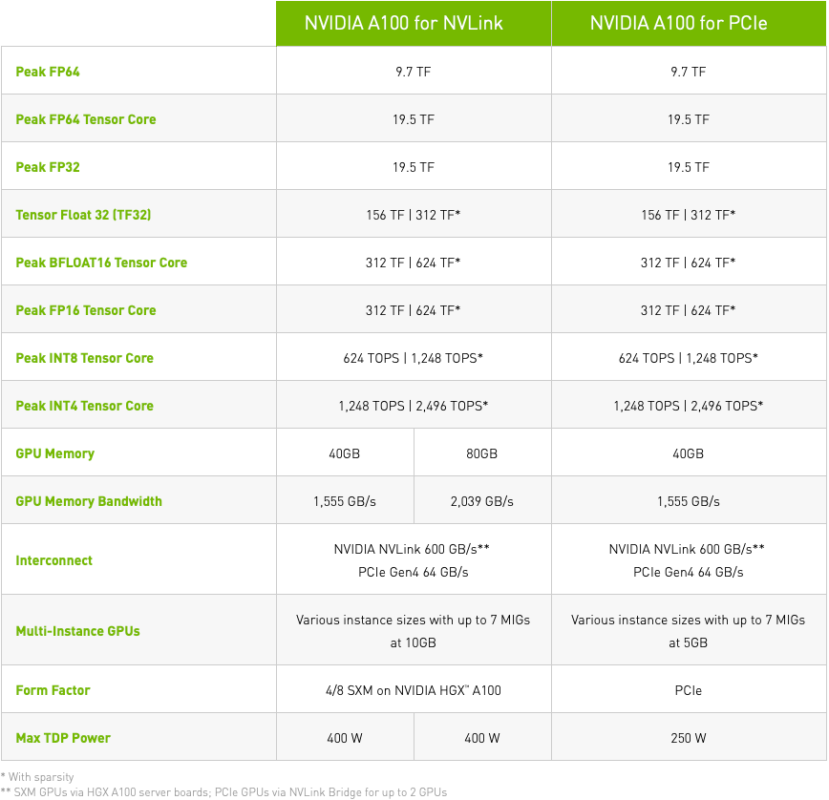

L’accélérateur A100-PCIe de Nvidia basé sur le GPU GA100 avec 6912 cœurs CUDA et 80 Go de mémoire HBM2E ECC (avec 2 To/s de bande passante) aura les mêmes compétences que l’accélérateur A100-SXM4 de l’entreprise avec 80 Go de mémoire, au moins en ce qui concerne le calcul les capacités (version 8.0) et les capacités de virtualisation/instance (jusqu’à sept instances) sont concernées. Il y aura bien sûr des différences en ce qui concerne les limites de puissance.

Nvidia n’a pas officiellement présenté sa carte de calcul A100-PCIe 80 Go HBM2E, mais comme elle est répertoriée dans un document officiel trouvé par VideoCardz , nous pouvons nous attendre à ce que la société la lance dans les prochains mois. Étant donné que la carte de calcul A100-PCIe 80 Go HBM2E n’a pas encore été lancée, il est impossible de connaître le prix réel. Les partenaires de CDW ont des cartes PCIe A100 avec 40 Go de mémoire pour 15 849 $ ~ 27 113 $ selon le revendeur exact, il est donc assez évident qu’une version 80 Go coûtera plus que cela.

Le facteur de forme GPU de calcul SXM propriétaire de Nvidia présente plusieurs avantages par rapport aux cartes PCIe classiques. Les derniers modules A100-SXM4 de Nvidia prennent en charge une puissance thermique maximale (TDP) allant jusqu’à 400 W (à la fois pour les versions 40 Go et 80 Go) car il est plus facile de fournir la quantité d’énergie nécessaire à ces modules et il est plus facile de les refroidir ( par exemple, en utilisant un système de refroidissement par réfrigérant dans la dernière station DGX A100). En revanche, les cartes PCIe A100 de Nvidia sont évaluées jusqu’à 250 W. Pendant ce temps, ils peuvent être utilisés à l’intérieur des serveurs rack ainsi que dans des postes de travail haut de gamme.

Les clients du centre de données cloud de Nvidia semblent préférer les modules SXM4 aux cartes. En conséquence, Nvidia a lancé pour la première fois son module A100-SXM4 40 Go HBM2E (avec 1,6 To/s de bande passante) l’année dernière et a suivi avec une version de carte PCIe plusieurs mois plus tard. La société a également présenté pour la première fois son module HBM2E A100-SXM4 80 Go (avec HBM2E plus rapide) en novembre dernier, mais n’a commencé à l’expédier que récemment.